Nos últimos dias, grandes empresas de tecnologia passaram a restringir ou bloquear o uso de agentes autônomos de inteligência artificial, como o OpenClaw, em ambientes corporativos. O discurso público menciona segurança da informação, uso malicioso e integridade de sistemas.

Mas há algo mais profundo acontecendo.

Quando plataformas e empresas afirmam que houve “aumento significativo de uso malicioso que compromete a qualidade e a segurança do serviço”, o problema não é apenas técnico. É jurídico.

Estamos diante de um novo tipo de risco: o risco autoral automatizado.

O que diferencia agentes como o OpenClaw

Modelos generativos tradicionais produzem texto, imagem ou código a partir de comandos. Agentes autônomos, por outro lado, executam tarefas.

Essa diferença é estrutural.

O OpenClaw pode:

- acessar arquivos locais;

- interagir com interfaces online;

- executar comandos sequenciais;

- automatizar fluxos completos de navegação e manipulação de conteúdo.

Isso significa que ele não apenas cria. Ele opera.

E operar implica potencialmente:

- copiar arquivos protegidos;

- reproduzir conteúdos licenciados;

- reorganizar bases de dados;

- armazenar trechos de obras sob proteção autoral.

A partir desse momento, a discussão deixa de ser sobre criatividade artificial e passa a ser sobre reprodução e uso de obra protegida.

A fricção com o Direito Autoral

O Direito Autoral foi estruturado com base em três pilares fundamentais:

- autoria humana;

- reprodução identificável;

- responsabilidade atribuível.

Agentes autônomos desorganizam essa lógica.

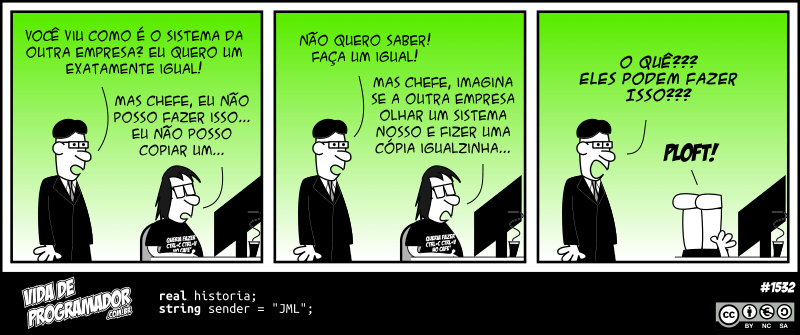

Se um agente acessa um banco de dados licenciado e armazena cópias temporárias para executar uma tarefa, houve reprodução?

Se houve reprodução, quem responde por ela?

Se o agente realiza múltiplas interações automatizadas sem supervisão direta, há dolo, culpa ou responsabilidade objetiva?

O problema central não é saber se a IA “é autora”.

O problema é saber quem assume os efeitos jurídicos das ações que ela executa.

O risco corporativo: por que proibir é mais seguro

Grandes empresas operam sob contratos complexos de licenciamento, acordos de confidencialidade, proteção de propriedade intelectual e responsabilidade civil ampliada.

Permitir que um agente autônomo atue livremente em um ambiente corporativo significa:

- ampliar a superfície de risco autoral;

- aumentar a possibilidade de infração contratual;

- dificultar rastreabilidade de ações;

- criar incerteza sobre atribuição de responsabilidade.

Sob essa ótica, a proibição não é conservadorismo tecnológico.

É gestão de risco jurídico.

Bloquear o uso de agentes como o OpenClaw pode funcionar como blindagem preventiva contra:

- alegações de reprodução indevida;

- uso não autorizado de conteúdo protegido;

- vazamento de obras sob licença restrita;

- responsabilização por atos automatizados.

A zona cinzenta normativa

A legislação brasileira de direitos autorais foi construída em um contexto analógico e adaptada ao ambiente digital, mas ainda não contempla expressamente agentes operacionais autônomos.

Hoje, a responsabilidade pode ser interpretada a partir de:

- teoria do risco da atividade;

- responsabilidade objetiva em ambientes empresariais;

- dever de vigilância e controle tecnológico;

- culpa in eligendo e in vigilando.

Mas essas soluções são adaptações. Não são respostas específicas.

A pergunta que permanece é direta:

Se um agente autônomo viola direitos autorais dentro de uma infraestrutura corporativa, estamos diante de falha humana, falha sistêmica ou novo tipo de responsabilidade tecnológica?

O impacto estrutural para o mercado criativo

A questão não afeta apenas empresas de tecnologia.

Ela impacta:

- criadores de conteúdo;

- titulares de direitos;

- plataformas digitais;

- desenvolvedores de software;

- empresas que utilizam automação para ganho de eficiência.

Se agentes autônomos podem acessar, copiar e reorganizar conteúdos protegidos, a proteção autoral deixa de depender apenas da intenção humana e passa a depender da arquitetura tecnológica.

Isso altera a forma como pensamos governança digital.

O precedente silencioso

O bloqueio do OpenClaw pode se tornar um precedente informal de mercado.

Quando grandes players optam por restringir agentes autônomos, sinalizam que:

- a governança de IA será mais restritiva em ambientes corporativos;

- a responsabilidade jurídica pesa mais que o ganho operacional imediato;

- a legislação ainda não oferece segurança suficiente para uso irrestrito.

Esse movimento pode antecipar regulações futuras.

Historicamente, práticas empresariais de contenção costumam preceder ajustes legislativos.

O que esperar daqui para frente

Três tendências são previsíveis:

- Políticas internas específicas para uso de agentes de IA.

- Cláusulas contratuais delimitando responsabilidade por automação.

- Debates legislativos sobre responsabilização por atos de sistemas autônomos.

A evolução tecnológica não desacelera.

Mas a responsabilização jurídica tende a se intensificar.

Conclusão

O caso OpenClaw não é apenas sobre segurança digital.

É sobre a transição de uma IA que gera para uma IA que executa.

E quando a execução envolve potencial reprodução de obras protegidas, o Direito Autoral deixa de ser periférico e passa a ser central.

A proibição em grandes empresas revela algo maior:

a inovação está avançando mais rápido do que a definição de responsabilidade.

E, no Direito, responsabilidade é sempre o ponto decisivo.